Scraping

Que signifie « web scraping » en Martech ?

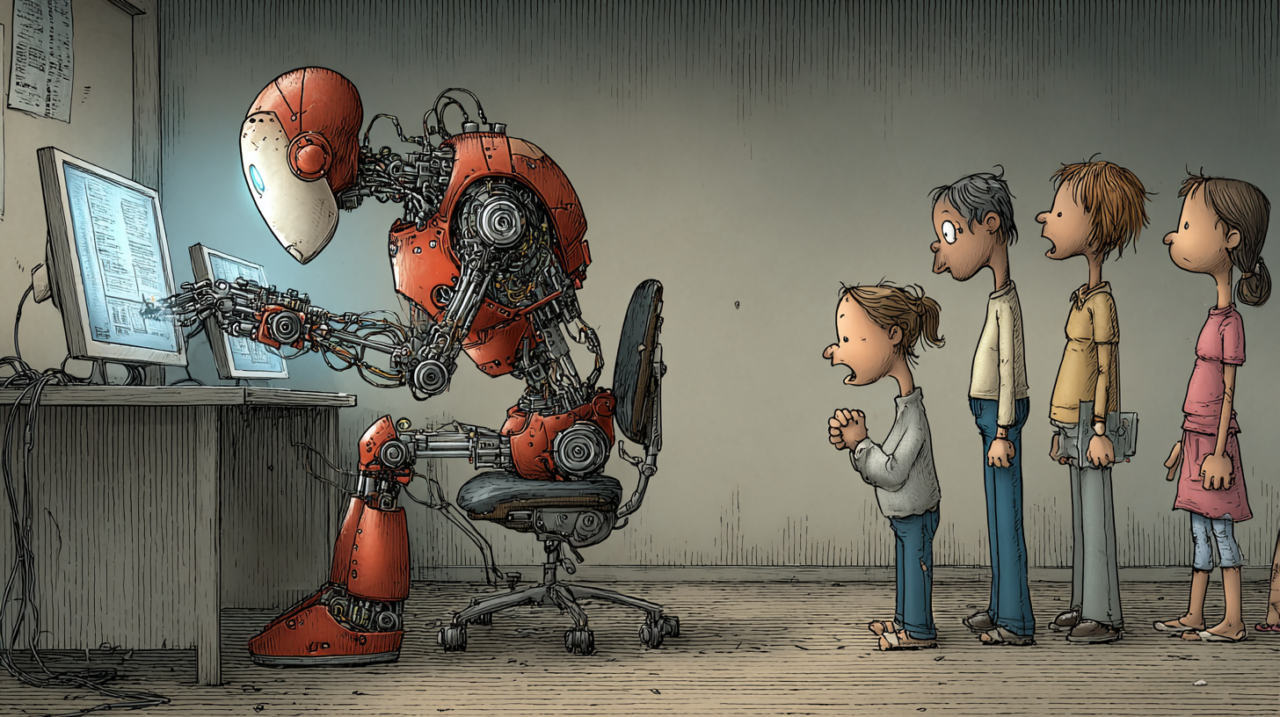

Le scraping, ou web scraping, désigne l’ensemble des techniques permettant d’extraire automatiquement des données depuis des sites web, des applications ou des plateformes digitales. Dans une perspective martech, il s’agit moins d’un simple outil technique que d’un levier stratégique au service de la collecte, de l’enrichissement et de l’exploitation de données externes.

Dans les pratiques marketing, le scraping permet d’accéder à des informations variées : prix concurrents, avis clients, catalogues produits, contenus éditoriaux ou encore signaux issus des réseaux sociaux. Ces données viennent ensuite alimenter des écosystèmes data plus larges, qu’il s’agisse de CRM, de plateformes d’automation ou d’outils d’analyse. L’objectif est clair : mieux comprendre son marché, affiner ses segmentations et optimiser ses performances.

Cette logique s’inscrit pleinement dans l’évolution vers un marketing piloté par la donnée. Le scraping devient alors une brique complémentaire aux données internes, souvent limitées, en ouvrant l’accès à un environnement concurrentiel et contextuel beaucoup plus riche.

Scraping et intelligence artificielle : une convergence naturelle

Avec l’essor de l’intelligence artificielle, le scraping a profondément évolué. Il ne se limite plus à une collecte brute de données structurées, mais s’inscrit dans une chaîne de valeur plus large.

D’un côté, le scraping alimente les modèles d’IA. Les grands modèles de langage, les systèmes de recommandation ou les algorithmes de vision par ordinateur reposent sur des volumes massifs de données souvent collectées en ligne. Le scraping devient alors une étape clé dans la constitution de ces jeux de données.

De l’autre, l’IA améliore les capacités de scraping. Elle permet d’interpréter des contenus non structurés, de comprendre le sens d’un texte, d’identifier automatiquement des informations pertinentes ou encore de s’adapter à des structures de pages complexes et changeantes.

Cette convergence transforme le scraping en un outil intelligent, capable non seulement de collecter, mais aussi de qualifier et de valoriser la donnée.

Des défis techniques loin d’être anodins

Derrière sa simplicité apparente, le scraping pose de nombreux défis techniques. Les sites web présentent des structures hétérogènes, souvent instables, qui nécessitent des ajustements constants. L’usage croissant de technologies dynamiques, notamment JavaScript, complexifie encore davantage l’extraction des données.

Par ailleurs, de nombreux acteurs mettent en place des mécanismes de protection contre le scraping : limitation du nombre de requêtes, blocage d’adresses IP, CAPTCHA ou encore modification fréquente du code des pages.

Ces dispositifs obligent les développeurs à concevoir des solutions robustes, capables de contourner ou d’éviter ces barrières sans compromettre la stabilité des systèmes.

La question de la qualité des données est également centrale. Les informations collectées peuvent être incomplètes, redondantes ou bruitées. Un travail important de nettoyage, de normalisation et de validation est donc nécessaire avant toute exploitation.

Enfin, à grande échelle, le scraping nécessite une infrastructure adaptée, capable de gérer des volumes importants de requêtes et de données, tout en garantissant des performances acceptables.

Un cadre légal et éthique complexe

Le scraping évolue dans un environnement juridique particulièrement sensible. Si certaines données sont librement accessibles, leur réutilisation n’est pas pour autant toujours autorisée.

Les conditions générales d’utilisation des sites web constituent un premier niveau de contrainte. De nombreuses plateformes interdisent explicitement toute extraction automatisée de leurs contenus. Le non-respect de ces obligations peut entraîner des poursuites..

Le droit d’auteur représente un autre enjeu majeur. Les contenus collectés — textes, images, bases de données — peuvent être protégés et leur utilisation soumise à autorisation.

En Europe, le RGPD encadre strictement la collecte et le traitement des données personnelles. Le scraping de données identifiables, même accessibles publiquement, peut ainsi poser des problèmes de conformité importants.

Au-delà du cadre légal, des questionnements éthiques émergent.. La collecte massive de données sans information ni consentement des utilisateurs interroge sur la transparence des pratiques. De même, l’utilisation de ces données pour entraîner des modèles d’IA soulève des débats sur la propriété intellectuelle et la rémunération des créateurs.

En conclusion

Le scraping occupe aujourd’hui une place stratégique dans l’écosystème martech. Il permet d’enrichir les analyses marketing, d’alimenter les modèles d’intelligence artificielle et d’ouvrir de nouvelles perspectives en matière de connaissance client et de veille concurrentielle.

Cependant, cette puissance repose sur un équilibre délicat. Les contraintes techniques, les exigences de qualité des données et les enjeux juridiques imposent une approche rigoureuse. Dans un contexte où l’IA amplifie les capacités comme les risques, le scraping ne peut plus être envisagé comme une simple technique, mais comme une pratique à encadrer, à maîtriser et à intégrer dans une stratégie globale responsable.